KI gegen Mensch, zwischen technischer Überlegenheit und fehlendem Vertrauen

Stellen wir uns jemanden vor, der medizinische Diagnosen stellt. Die Ergebnisse liegen auf dem Niveau erfahrener Fachärzte, gelegentlich sogar darüber. Die Analysen sind sauber, die Argumentation klar, die Berichte präzise.

Und trotzdem gibt es keinen Namen am Praxisschild, keine Zulassung an der Wand, keine klar erkennbare Verantwortung. Niemand, den man anrufen kann, wenn etwas schiefgeht.

Würdest du dich behandeln lassen? Viele Menschen würden zögern.

Genau dort steht Künstliche Intelligenz (KI) heute in der Kommunikation. Technisch stark, nachweislich leistungsfähig und dennoch mit einer deutlichen Vertrauenslücke konfrontiert. Für die PR ist das kein Nebenaspekt, sondern eine zentrale strategische Frage.

Übersicht

Der Mythos der überlegenen Maschine

Die Öffentlichkeit bleibt skeptisch

Der Mythos der überlegenen Maschine

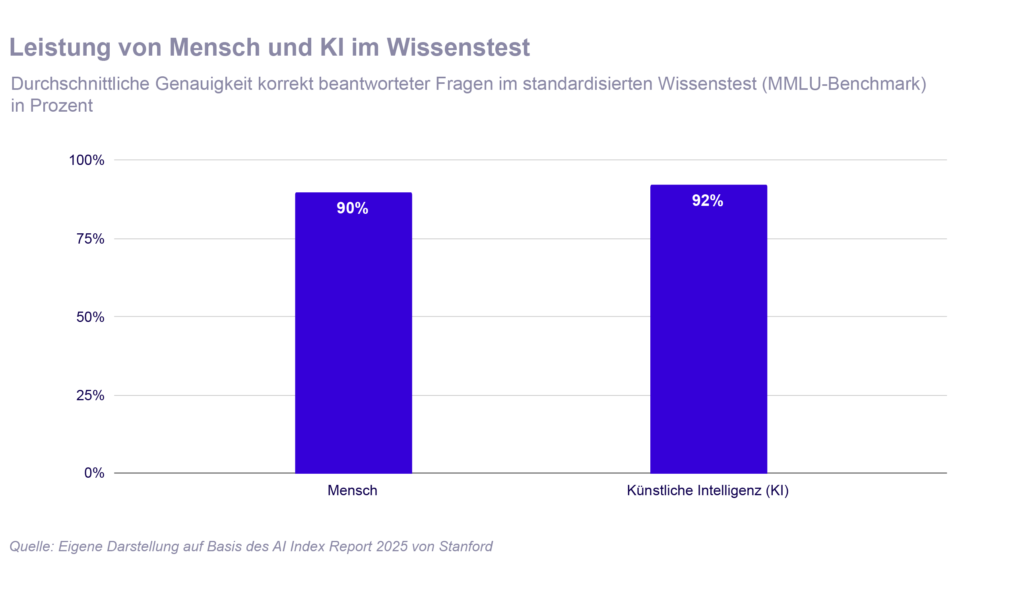

In der PR-Branche liegt seit einiger Zeit eine spürbare Nervosität in der Luft. KI-Tools schreiben Texte, analysieren Stimmungen, liefern Recherchen und Strategievorschläge in Sekunden. Die leise Frage dahinter: Wie viel Platz bleibt da noch für menschliche Kommunikationsexperten?Ein Blick in die Daten scheint diese Unsicherheit sogar zu stützen. Im Stanford AI Index Report 2025 werden moderne KI-Systeme systematisch mit menschlichen Referenzwerten verglichen. In einem Wissenstest mit Aufgaben aus 57 Disziplinen, von Geistes- bis Naturwissenschaften, erreicht das leistungsstärkste Modell eine Genauigkeit von 92 Prozent. Die menschliche Vergleichsgruppe liegt bei 90 Prozent (Stanford AI Index Report 2025).

Die Differenz wirkt auf den ersten Blick nicht dramatisch. Symbolisch ist sie jedoch enorm. KI bewegt sich längst nicht mehr nur im Feld einfacher Automatisierung oder reiner Rechenleistung. Sie beantwortet komplexe Wissensfragen, verknüpft Inhalte disziplinübergreifend und argumentiert strukturiert auf einem Niveau, das lange als unangefochten menschlich galt.

Es gibt nur noch wenige Felder, in denen Menschen deutlich überlegen sind. Rein technisch betrachtet lautet das Zwischenfazit: Mit wachsender Kompetenz der Maschinen ist der Gedanke an Ersetzbarkeit nicht mehr völlig abwegig.

Doch genau hier beginnt die entscheidende Frage. Reicht Kompetenz in der Kommunikation wirklich aus?

Die Öffentlichkeit bleibt skeptisch

Denn während KI in standardisierten Tests überzeugt, fällt das Vertrauen der Öffentlichkeit deutlich verhaltener aus.Eine repräsentative Online-Befragung von YouGov aus dem Jahr 2025 zeigt, dass 54 Prozent der Befragten in Deutschland KI-generierten Nachrichten weniger vertrauen als rein menschlich verfassten Inhalten. Nur 9 Prozent geben an, solchen Inhalten mehr zu vertrauen (YouGov Online-Befragung 2025).

Mehr als jede zweite Person begegnet KI-Content also mit Skepsis.

Das ist keine Randnotiz, sondern eine strukturelle Diskrepanz. Auf der einen Seite messbare Leistungsfähigkeit, auf der anderen Seite ein klarer Vertrauensvorbehalt.

Wenn der Absender wichtiger ist als die Antwort

Hier beginnt die eigentliche Relevanz für die PR. Botschaften setzen sich nicht nur durch, weil sie fachlich korrekt sind, sondern weil sie als glaubwürdig gelten.

Menschen vertrauen nicht nur Informationen, sondern denjenigen, die für diese Informationen stehen. Genau hier zeigt sich, selbst wenn zwei Diagnosen identisch sind, bleibt die Frage: Wer trägt Verantwortung? Wer ist adressierbar? Wer steht mit Name, Biografie und Institution für die Aussage ein?

Überträgt man dieses Bild auf KI, wird der Konflikt deutlich. Die Systeme liefern perfekte Ergebnisse, sie haben aber keine Biografie und keinen persönlichen Ruf. Es gibt keinen Werdegang, keine Berufsethik, keine individuelle Haftung. Vertrauen entsteht jedoch nicht allein durch korrekte Ergebnisse, sondern durch Identität und Transparenz.

Für die PR ist das entscheidend. Der Einsatz von KI kann Prozesse optimieren und Inhalte effizienter produzieren. Doch sobald der Eindruck entsteht, Inhalte seien anonym, unkontrolliert oder entkoppelt von menschlicher Verantwortung, kann genau diese Effizienz zum Reputationsrisiko werden.

Die Diagnose für Kommunikationsverantwortliche

Die Diskussion sollte daher nicht einfach in der Entscheidung zwischen „Mensch oder Maschine“ enden. Die Leistungsdaten zeigen, dass KI-Systeme auf hohem Niveau operieren können. Gleichzeitig verdeutlichen die Vertrauenswerte, dass Akzeptanz nicht automatisch mit technischer Qualität wächst.

Für Kommunikationsverantwortliche ergibt sich daraus eine doppelte Aufgabe:

Erstens: KI strategisch nutzen, nicht aus Reflex meiden.

KI kann Routinen übernehmen, Daten auswerten, Stimmungen in Echtzeit analysieren und erste Entwürfe liefern. Sie erkennt Muster in großen Informationsmengen, identifiziert Themenpotenziale und unterstützt bei der Planung. Wer das ignoriert, verschenkt Potenzial.

Zweitens: Menschliche Verantwortung sichtbar halten.

Jede KI-gestützte Kommunikation braucht ein erkennbares Gesicht. Jemanden, der Inhalte verantwortet, Quellen prüft und Entscheidungen erklärt. Transparenz über den Einsatz von KI, redaktionelle Kontrolle und nachvollziehbare Quellenarbeit gehören zur professionellen Praxis, nicht aus Misstrauen gegenüber der Technik, sondern aus Respekt vor den Adressaten.

So relativiert sich auch die Angst vor vollständiger Ersetzbarkeit. Selbst wenn KI in Tests auf Augenhöhe mit Menschen agiert, bleibt der Mensch als Vertrauensinstanz zentral. Nicht trotz der Maschine, sondern gerade wegen ihr!

Methodischer Hinweis & Quellen

Die dargestellten Leistungsdaten basieren auf dem MMLU-Benchmark, einem standardisierten Test zur Überprüfung von allgemeinem Wissen in 57 verschiedenen Fachbereichen. Verglichen werden die durchschnittliche Genauigkeit einer menschlichen Referenzgruppe und die Leistung eines aktuellen KI-Modells. Die Daten stammen aus dem AI Index Report 2025 (Stanford AI Index Report 2025).

Die dargestellten Vertrauensdaten basieren auf einer national repräsentativen Online-Umfrage von YouGov in Deutschland mit 1001 Befragten (Nat rep). Die Erhebung wurde vom 16. Dezember 2024 bis 2. Januar 2025 durchgeführt. Gezeigt werden die Ergebnisse der repräsentativen Gesamtstichprobe, nicht die nach Altersgruppen aufgeschlüsselten Werte. Die Befragten wurden gefragt: „Do you trust news content generated by AI as much as content created by humans?“ Es handelte sich um eine Einfachauswahl-Frage mit vier Antwortoptionen („Trust more“, „Trust equally“, „Trust less“, „Don’t know“). Die Daten stammen aus der Studie „Generative AI in media 2025 – Germany“ (YouGov Online-Befragung 2025).

Über den Autor

Das Schweizer Taschenmesser der Medienproduktion: Elias Pflüger ist ein vielseitiger Medienproduzent und Gründer von Spice it up!®. Er kombiniert Design (Web, Print, 3D), Videoschnitt, Social Media, KI und Projektmanagement mit sicherem Umgang in Tools wie Photoshop, Illustrator, InDesign, Fusion 360, Figma und mehr – ein echtes Allroundtalent der Medienwelt.

Ein weiterer Beitrag des Autors: KI greift an: 5 fiese Maschen, die dein Business bedrohen